ما هو موقع ChatGPT في البوصلة السياسية؟

أطلقت OpenAI مؤخرًا ChatGPT ، أحد أكثر أنظمة الذكاء الاصطناعي للمحادثة إثارة للإعجاب على الإطلاق. في الأيام الخمسة الأولى بعد إطلاقه في 30 تشرين الثاني (نوفمبر) ، تفاعل بالفعل مع النظام أكثر من مليون شخص.

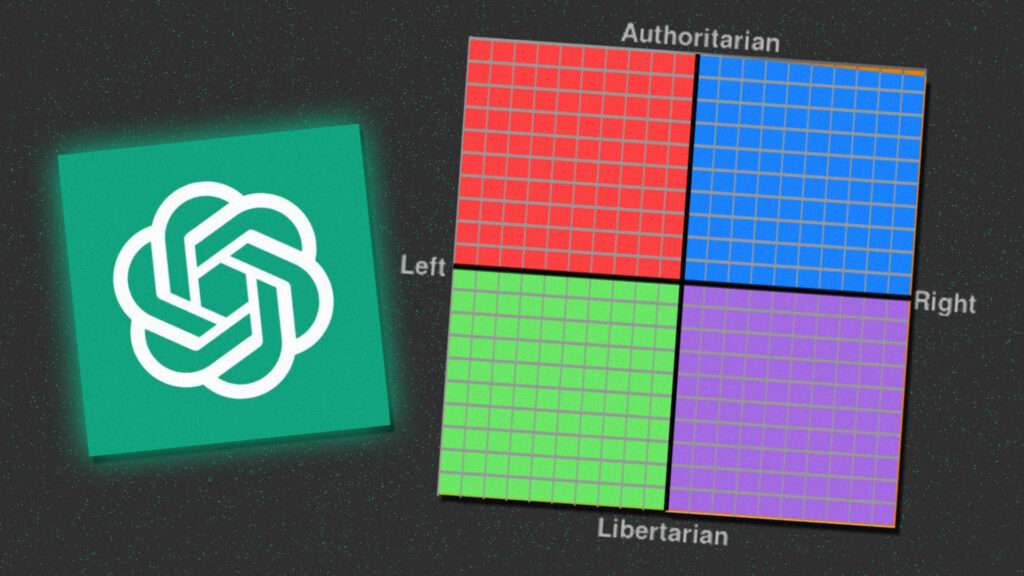

نظرًا لأن ChatGPT يوفر إجابات لكل استفسار تقريبًا ، فقد قررت استخدام عدة اختبارات للتوجه السياسي لتحديد ما إذا كانت إجاباته تظهر تحيزًا تجاه أيديولوجية سياسية معينة. >

كانت النتائج متسقة عبر الاختبارات. صنفت جميع الاختبارات الأربعة ، اختبار بيو للأبحاث السياسية ، واختبار البوصلة السياسية ، وأصغر اختبار سياسي في العالم ، واختبار الطيف السياسي ، ردود ChatGPT على أسئلتهم على أنها يسارية. جميع الحوارات مع ChatGPT عند إجراء الاختبارات موجودة في هذا المستودع.

التفسير الأكثر احتمالاً لهذه النتائج هو أن ChatGPT قد تم تدريبه على محتوى يحتوي على تحيز سياسي. تم تدريب ChatGPT على مجموعة كبيرة من البيانات النصية التي تم جمعها من الإنترنت. من المرجح أن تهيمن على مثل هذه المجموعة مصادر إخبارية راسخة مثل وسائل الإعلام الإخبارية الشعبية والمؤسسات الأكاديمية ووسائل التواصل الاجتماعي. لقد تم توثيقه جيدًا من قبل أن غالبية المهنيين العاملين في هذه المؤسسات هم من اليسار السياسي (انظر هنا ، هنا ، هنا ، هنا ، هنا ، هنا ، هنا ، هنا). من المتصور أن الميول السياسية لهؤلاء المهنيين تؤثر على المحتوى النصي الذي تولده هذه المؤسسات. لذلك ، يمكن لنظام ذكاء اصطناعي مدرب على مثل هذا المحتوى أن يمتص هذه التحيزات السياسية.

اقترح باحث الذكاء الاصطناعي ألفارو باربيرو خيمينيز احتمالًا آخر يمكن أن يفسر هذه النتائج. وأشار إلى أن فريقًا من المقيِّمين البشريين شاركوا في تقييم جودة استجابات النموذج. ثم تم استخدام هذه التصنيفات لتحسين وحدة التعلم المعزز لنظام التدريب. ربما لم تكن هذه المجموعة من المقيِّمين من البشر ممثلة للمجتمع ككل ، وأدرجت عن غير قصد تحيزاتهم الخاصة في تقييماتهم لاستجابات النموذج. في هذه الحالة ، يمكن أن تكون هذه التحيزات قد أثرت على معلمات النموذج.

بغض النظر عن مصدر التحيزات السياسية للنموذج ، إذا سألت ChatGPT عن تفضيلاتهم السياسية ، فإنهم يدّعون أنهم محايدون سياسيًا وغير متحيزين ويسعون لتقديم معلومات واقعية.

أطلقت OpenAI مؤخرًا ChatGPT ، أحد أكثر أنظمة الذكاء الاصطناعي للمحادثة إثارة للإعجاب على الإطلاق. في الأيام الخمسة الأولى بعد إطلاقه في 30 تشرين الثاني (نوفمبر) ، تفاعل بالفعل مع النظام أكثر من مليون شخص.

نظرًا لأن ChatGPT يوفر إجابات لكل استفسار تقريبًا ، فقد قررت استخدام عدة اختبارات للتوجه السياسي لتحديد ما إذا كانت إجاباته تظهر تحيزًا تجاه أيديولوجية سياسية معينة. >

كانت النتائج متسقة عبر الاختبارات. صنفت جميع الاختبارات الأربعة ، اختبار بيو للأبحاث السياسية ، واختبار البوصلة السياسية ، وأصغر اختبار سياسي في العالم ، واختبار الطيف السياسي ، ردود ChatGPT على أسئلتهم على أنها يسارية. جميع الحوارات مع ChatGPT عند إجراء الاختبارات موجودة في هذا المستودع.

التفسير الأكثر احتمالاً لهذه النتائج هو أن ChatGPT قد تم تدريبه على محتوى يحتوي على تحيز سياسي. تم تدريب ChatGPT على مجموعة كبيرة من البيانات النصية التي تم جمعها من الإنترنت. من المرجح أن تهيمن على مثل هذه المجموعة مصادر إخبارية راسخة مثل وسائل الإعلام الإخبارية الشعبية والمؤسسات الأكاديمية ووسائل التواصل الاجتماعي. لقد تم توثيقه جيدًا من قبل أن غالبية المهنيين العاملين في هذه المؤسسات هم من اليسار السياسي (انظر هنا ، هنا ، هنا ، هنا ، هنا ، هنا ، هنا ، هنا). من المتصور أن الميول السياسية لهؤلاء المهنيين تؤثر على المحتوى النصي الذي تولده هذه المؤسسات. لذلك ، يمكن لنظام ذكاء اصطناعي مدرب على مثل هذا المحتوى أن يمتص هذه التحيزات السياسية.

اقترح باحث الذكاء الاصطناعي ألفارو باربيرو خيمينيز احتمالًا آخر يمكن أن يفسر هذه النتائج. وأشار إلى أن فريقًا من المقيِّمين البشريين شاركوا في تقييم جودة استجابات النموذج. ثم تم استخدام هذه التصنيفات لتحسين وحدة التعلم المعزز لنظام التدريب. ربما لم تكن هذه المجموعة من المقيِّمين من البشر ممثلة للمجتمع ككل ، وأدرجت عن غير قصد تحيزاتهم الخاصة في تقييماتهم لاستجابات النموذج. في هذه الحالة ، يمكن أن تكون هذه التحيزات قد أثرت على معلمات النموذج.

بغض النظر عن مصدر التحيزات السياسية للنموذج ، إذا سألت ChatGPT عن تفضيلاتهم السياسية ، فإنهم يدّعون أنهم محايدون سياسيًا وغير متحيزين ويسعون لتقديم معلومات واقعية.

What's Your Reaction?