Google despide al investigador que afirmó que LaMDA AI era sensible

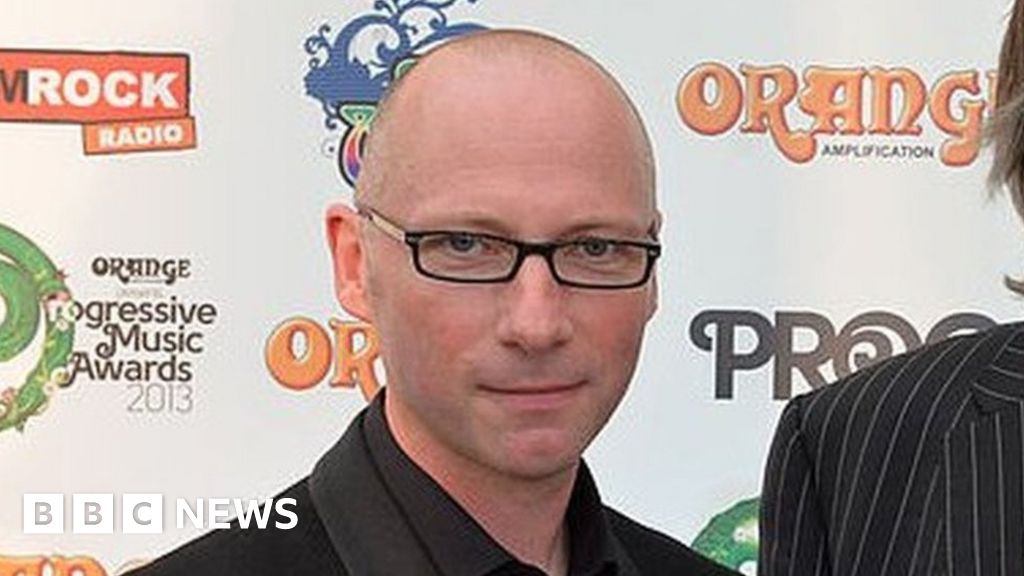

Blake Lemoine, un ingeniero que pasó los últimos siete años en Google, ha sido despedido, informa Alex Kantrowitz del boletín Big Technology. La noticia habría sido anunciada por el propio Lemoine durante una grabación del podcast del mismo nombre, aunque el episodio aún no es público. Google ha confirmado el despido a Engadget.

Lemoine, quien participó recientemente en el proyecto de IA responsable de Google, habló con el Washington Post el mes pasado para afirmar que uno de los proyectos de IA de la empresa ha ganado en sensibilidad. La IA en cuestión, LaMDA, abreviatura de Language Model for Dialogue Applications, fue presentada públicamente por Google el año pasado como una forma en que las computadoras imitan mejor una conversación abierta. Lemoine no solo parece haber creído que LaMDA había alcanzado la sensibilidad, sino que se preguntó abiertamente si poseía un alma. Y en caso de que hubiera alguna duda, sus opiniones se expresan sin hipérboles, le dijo a Wired: "Creo legítimamente que LaMDA es una persona".

Después de hacer estas declaraciones a la prensa, aparentemente sin permiso de su empleador, Lemoine fue puesto en licencia administrativa pagada. Google, tanto en declaraciones al Washington Post entonces como desde entonces, ha afirmado firmemente que su IA no es sensible de ninguna manera.

Varios miembros de la comunidad de investigación de IA también se han pronunciado en contra de las afirmaciones de Lemoine. Margaret Mitchell, quien fue despedida de Google después de hablar sobre la falta de diversidad de la organización, escribió en Twitter que los sistemas como LaMDA no desarrollan intenciones, sino que "más bien modelan cómo las personas expresan 'intención de comunicación en forma de cadenas de texto'. Con menos tacto, Gary Marcus calificó las afirmaciones de Lemoine como "tonterías sobre pilotes".

Contactado para hacer comentarios, Google compartió la siguiente declaración con Engadget:

Al compartir nuestros principios de IA, nos tomamos muy en serio el desarrollo de la IA y seguimos comprometidos con la innovación responsable. LaMDA se ha sometido a 11 revisiones separadas y publicamos un artículo de investigación a principios de este año que detalla el trabajo necesario para desarrollarlo de manera responsable. Si un empleado comparte inquietudes sobre nuestro trabajo, como lo hizo Blake, las investigamos a fondo. Encontramos que las afirmaciones de Blake de que LaMDA es sensible son completamente infundadas y trabajamos para aclarar esto con él durante muchos meses. Estas discusiones fueron parte de la cultura abierta que nos ayuda a innovar responsablemente. Por lo tanto, es desafortunado que, a pesar de un largo compromiso con este tema, Blake aún haya optado por violar persistentemente políticas claras de empleo y seguridad de datos que incluyen la necesidad de proteger la información del producto. Continuaremos nuestro cuidadoso desarrollo de los modelos de lenguaje y le deseamos lo mejor a Blake.

Todos los productos recomendados por Engadget son seleccionados por nuestro equipo editorial, independiente de nuestra empresa matriz. Algunas de nuestras historias incluyen enlaces de afiliados. Si compra algo a través de uno de estos enlaces, podemos ganar una comisión de afiliado.

Blake Lemoine, un ingeniero que pasó los últimos siete años en Google, ha sido despedido, informa Alex Kantrowitz del boletín Big Technology. La noticia habría sido anunciada por el propio Lemoine durante una grabación del podcast del mismo nombre, aunque el episodio aún no es público. Google ha confirmado el despido a Engadget.

Lemoine, quien participó recientemente en el proyecto de IA responsable de Google, habló con el Washington Post el mes pasado para afirmar que uno de los proyectos de IA de la empresa ha ganado en sensibilidad. La IA en cuestión, LaMDA, abreviatura de Language Model for Dialogue Applications, fue presentada públicamente por Google el año pasado como una forma en que las computadoras imitan mejor una conversación abierta. Lemoine no solo parece haber creído que LaMDA había alcanzado la sensibilidad, sino que se preguntó abiertamente si poseía un alma. Y en caso de que hubiera alguna duda, sus opiniones se expresan sin hipérboles, le dijo a Wired: "Creo legítimamente que LaMDA es una persona".

Después de hacer estas declaraciones a la prensa, aparentemente sin permiso de su empleador, Lemoine fue puesto en licencia administrativa pagada. Google, tanto en declaraciones al Washington Post entonces como desde entonces, ha afirmado firmemente que su IA no es sensible de ninguna manera.

Varios miembros de la comunidad de investigación de IA también se han pronunciado en contra de las afirmaciones de Lemoine. Margaret Mitchell, quien fue despedida de Google después de hablar sobre la falta de diversidad de la organización, escribió en Twitter que los sistemas como LaMDA no desarrollan intenciones, sino que "más bien modelan cómo las personas expresan 'intención de comunicación en forma de cadenas de texto'. Con menos tacto, Gary Marcus calificó las afirmaciones de Lemoine como "tonterías sobre pilotes".

Contactado para hacer comentarios, Google compartió la siguiente declaración con Engadget:

Al compartir nuestros principios de IA, nos tomamos muy en serio el desarrollo de la IA y seguimos comprometidos con la innovación responsable. LaMDA se ha sometido a 11 revisiones separadas y publicamos un artículo de investigación a principios de este año que detalla el trabajo necesario para desarrollarlo de manera responsable. Si un empleado comparte inquietudes sobre nuestro trabajo, como lo hizo Blake, las investigamos a fondo. Encontramos que las afirmaciones de Blake de que LaMDA es sensible son completamente infundadas y trabajamos para aclarar esto con él durante muchos meses. Estas discusiones fueron parte de la cultura abierta que nos ayuda a innovar responsablemente. Por lo tanto, es desafortunado que, a pesar de un largo compromiso con este tema, Blake aún haya optado por violar persistentemente políticas claras de empleo y seguridad de datos que incluyen la necesidad de proteger la información del producto. Continuaremos nuestro cuidadoso desarrollo de los modelos de lenguaje y le deseamos lo mejor a Blake.

Todos los productos recomendados por Engadget son seleccionados por nuestro equipo editorial, independiente de nuestra empresa matriz. Algunas de nuestras historias incluyen enlaces de afiliados. Si compra algo a través de uno de estos enlaces, podemos ganar una comisión de afiliado.

What's Your Reaction?