Чому авторизовані дипфейки стають важливими для компаній

Приєднуйтесь до нас 9 листопада, щоб дізнатися, як успішно впроваджувати інновації та підвищувати ефективність шляхом вдосконалення та масштабування громадянських розробників на саміті Low-Code/No-Code Summit. Зареєструйтеся тут.

Наталі Монбіот, керівник відділу стратегії синтетичної медіакомпанії Hour One, не любить слово «дипфейки».

«Deepfake передбачає несанкціоноване використання синтетичних медіа та генеративного штучного інтелекту — ми маємо ліцензію з самого початку», — сказала вона VentureBeat.

Вона описала Hour One, що базується в Тель-Авіві та Нью-Йорку, як компанію зі штучного інтелекту, яка також «створила правову та етичну основу для того, як взаємодіяти з реальними людьми, щоб створити їхню схожість у цифровій формі».

Дозволено та неавторизовано. Це важливе розмежування в той час, коли deepfakes або синтетичні медіа, у яких людину на наявному зображенні чи відео замінюють на чужу подобу, отримали масу поганої інформації у пресі — що не дивно. , враховуючи давній зв’язок deepfakes із помстою. порно та фейкові новини. Термін «deepfake» можна віднести до користувача Reddit у 2017 році під назвою «deepfakes», який разом з іншими членами спільноти ділився відео, багато з яких передбачали зміну обличчя знаменитостей на тіла актрис у порнографічних відео.

ПодіяВершина з низьким кодом/без коду

Дізнайтеся, як створювати, масштабувати та керувати програмами з низьким кодом у простий спосіб, який принесе успіх для всіх цього 9 листопада. Підпишіться на безкоштовний абонемент сьогодні.

зареєструватися тутЗгідно з нещодавньою дослідницькою статтею Еріка Горвіца, наукового директора Microsoft, назрівають глибокі загрози. До них належать інтерактивні дипфейки, які створюють ілюзію розмови з реальною людиною, і композиційні дипфейки, де погані актори створюють численні дипфейки, щоб скласти «синтетичну історію».

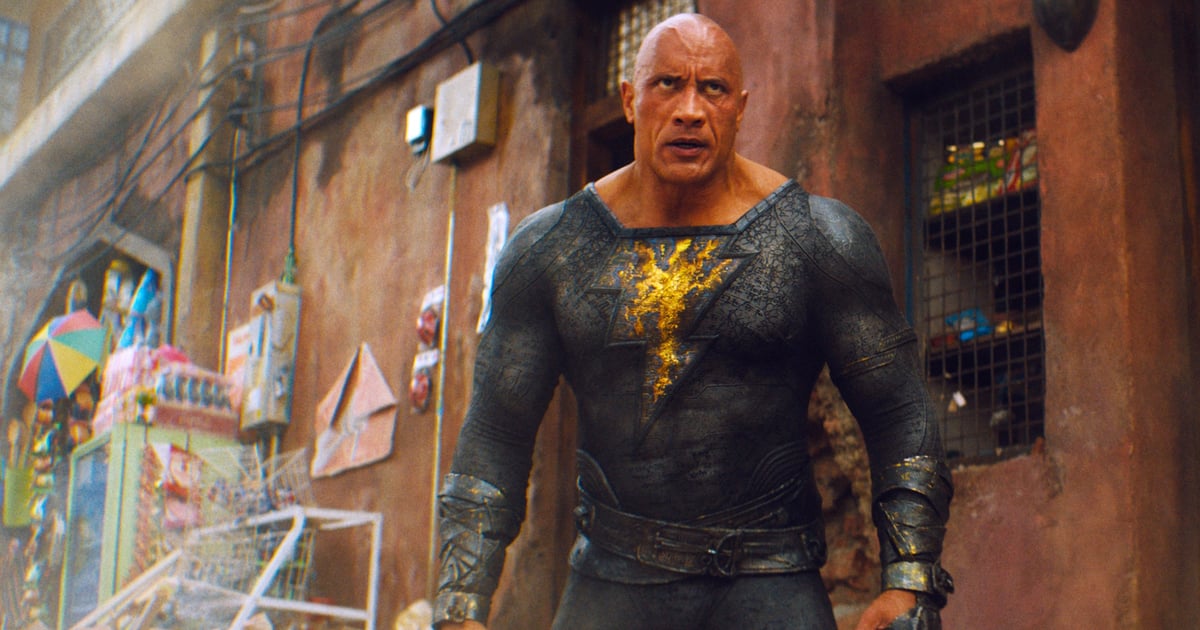

Останнім часом почастішали повідомлення про глибокі фейки знаменитостей. У Wall Street Journal висвітлено дипфейки Тома Круза, Ілона Маска та Леонардо Ді Капріо, які несанкціоновано з’являються в рекламі, а також чутки про те, що Брюс Вілліс відмовляється від прав на свою глибоку подобу (це неправда).

Ділова сторона дебатів про глибокі фейкиАле є й інша сторона дискусії про deepfake, кажуть кілька постачальників, що спеціалізуються на технології синтетичних медіа. А як щодо авторизованих дипфейків, які використовуються для створення професійного відео?

Більшість випадків використання глибокопідроблених відео, як вони стверджують, цілком допустимі. Їх можна знайти в корпоративних налаштуваннях – наприклад, для навчання співробітників, навчання та електронної комерції. Або вони можуть бути створені такими користувачами, як знаменитості та власники бізнесу, які хочуть скористатися перевагами синтетичних носіїв, щоб «аутсорсингувати» віртуального близнюка.

У цих випадках ідея полягає у використанні синтетичних медіа — у формі віртуальних людей — для вирішення дорогих, складних і немасштабованих проблем традиційного відеовиробництва, особливо в епоху, коли...

Приєднуйтесь до нас 9 листопада, щоб дізнатися, як успішно впроваджувати інновації та підвищувати ефективність шляхом вдосконалення та масштабування громадянських розробників на саміті Low-Code/No-Code Summit. Зареєструйтеся тут.

Наталі Монбіот, керівник відділу стратегії синтетичної медіакомпанії Hour One, не любить слово «дипфейки».

«Deepfake передбачає несанкціоноване використання синтетичних медіа та генеративного штучного інтелекту — ми маємо ліцензію з самого початку», — сказала вона VentureBeat.

Вона описала Hour One, що базується в Тель-Авіві та Нью-Йорку, як компанію зі штучного інтелекту, яка також «створила правову та етичну основу для того, як взаємодіяти з реальними людьми, щоб створити їхню схожість у цифровій формі».

Дозволено та неавторизовано. Це важливе розмежування в той час, коли deepfakes або синтетичні медіа, у яких людину на наявному зображенні чи відео замінюють на чужу подобу, отримали масу поганої інформації у пресі — що не дивно. , враховуючи давній зв’язок deepfakes із помстою. порно та фейкові новини. Термін «deepfake» можна віднести до користувача Reddit у 2017 році під назвою «deepfakes», який разом з іншими членами спільноти ділився відео, багато з яких передбачали зміну обличчя знаменитостей на тіла актрис у порнографічних відео.

ПодіяВершина з низьким кодом/без коду

Дізнайтеся, як створювати, масштабувати та керувати програмами з низьким кодом у простий спосіб, який принесе успіх для всіх цього 9 листопада. Підпишіться на безкоштовний абонемент сьогодні.

зареєструватися тутЗгідно з нещодавньою дослідницькою статтею Еріка Горвіца, наукового директора Microsoft, назрівають глибокі загрози. До них належать інтерактивні дипфейки, які створюють ілюзію розмови з реальною людиною, і композиційні дипфейки, де погані актори створюють численні дипфейки, щоб скласти «синтетичну історію».

Останнім часом почастішали повідомлення про глибокі фейки знаменитостей. У Wall Street Journal висвітлено дипфейки Тома Круза, Ілона Маска та Леонардо Ді Капріо, які несанкціоновано з’являються в рекламі, а також чутки про те, що Брюс Вілліс відмовляється від прав на свою глибоку подобу (це неправда).

Ділова сторона дебатів про глибокі фейкиАле є й інша сторона дискусії про deepfake, кажуть кілька постачальників, що спеціалізуються на технології синтетичних медіа. А як щодо авторизованих дипфейків, які використовуються для створення професійного відео?

Більшість випадків використання глибокопідроблених відео, як вони стверджують, цілком допустимі. Їх можна знайти в корпоративних налаштуваннях – наприклад, для навчання співробітників, навчання та електронної комерції. Або вони можуть бути створені такими користувачами, як знаменитості та власники бізнесу, які хочуть скористатися перевагами синтетичних носіїв, щоб «аутсорсингувати» віртуального близнюка.

У цих випадках ідея полягає у використанні синтетичних медіа — у формі віртуальних людей — для вирішення дорогих, складних і немасштабованих проблем традиційного відеовиробництва, особливо в епоху, коли...

What's Your Reaction?