Чому Deepfake Phishing є загрозливою катастрофою

Перегляньте всі сеанси Smart Security Summit за запитом тут.

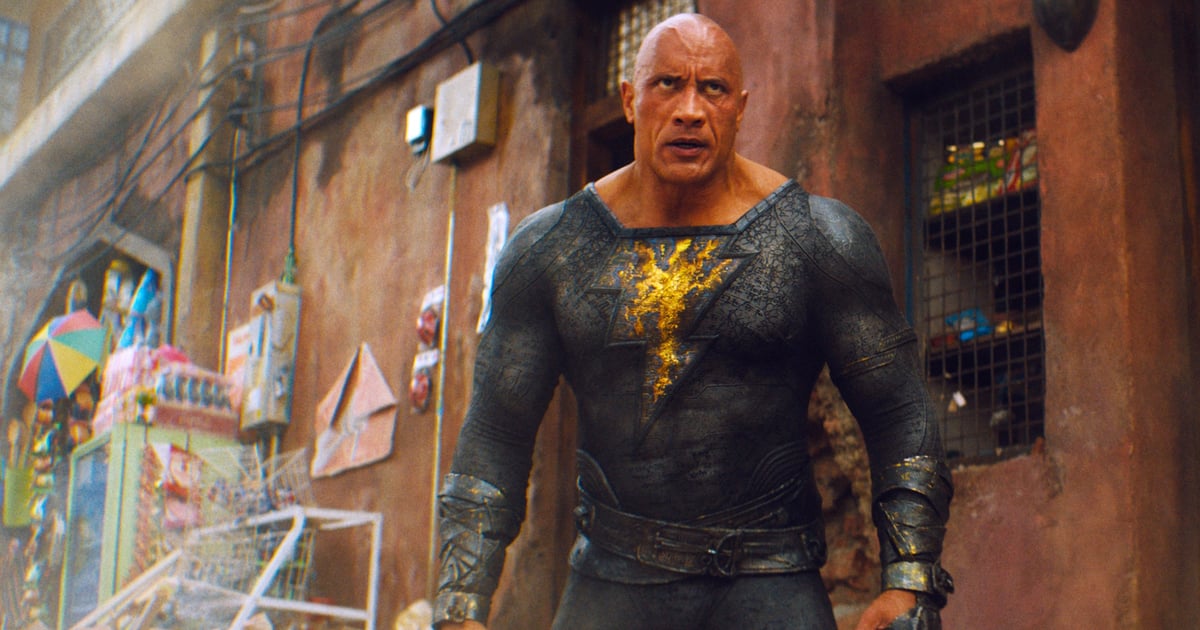

Не завжди все так, як здається. У міру розвитку технології штучного інтелекту (ШІ) люди почали використовувати її для спотворення реальності. Вони створили синтетичні зображення та відео всіх, від Тома Круза та Марка Цукерберга до президента Обами. Хоча багато з цих випадків використання є нешкідливими, інші додатки, такі як deepfake фішинг, є набагато мерзеннішими.

Хвиля зловмисників використовує штучний інтелект для створення синтетичного аудіо, зображень і відеовмісту, призначеного для видавання довірених осіб, таких як генеральні директори та інші керівники, щоб обманом змусити співробітників передати інформацію.

Однак більшість компаній просто не готові протистояти цим типам загроз. У 2021 році аналітик Gartner Дарін Стюарт написав допис у блозі, в якому попередив, що «підприємства намагаються захищатися від атак програм-вимагачів і не роблять нічого, щоб підготуватися до неминучої атаки на синтетичних медіа».

Зі стрімким розвитком штучного інтелекту та таких постачальників, як OpenAI, які демократизують доступ до штучного інтелекту та машинного навчання за допомогою нових інструментів, таких як ChatGPT, організації не можуть дозволити собі ігнорувати загрозу соціальної інженерії, яку створюють глибокі фейки. Якщо вони це зроблять, вони стануть уразливими до витоку даних.

ПодіяСаміт Smart Security за запитом

Дізнайтеся про важливу роль штучного інтелекту та машинного навчання в кібербезпеці та практичні приклади для окремих галузей. Дивіться сеанси за запитом сьогодні.

ПослухайтеХоча технологія deepfake все ще перебуває в зародковому стані, її популярність зростає. Кіберзлочинці вже починають експериментувати з ним, щоб атакувати нічого не підозрюючих користувачів і організації.

За даними Всесвітнього економічного форуму (WEF), кількість онлайн-відео з дипфейками зростає щорічно на 900%. Тим часом VMware виявила, що двоє з трьох захисників стверджують, що вони бачили використання шкідливих глибоких фейків як частину атаки, що на 13% більше, ніж минулого року.

Ці атаки можуть бути надзвичайно ефективними. Наприклад, у 2021 році кіберзлочинці використовували клонування голосу ШІ, щоб видати себе за генерального директора...

Перегляньте всі сеанси Smart Security Summit за запитом тут.

Не завжди все так, як здається. У міру розвитку технології штучного інтелекту (ШІ) люди почали використовувати її для спотворення реальності. Вони створили синтетичні зображення та відео всіх, від Тома Круза та Марка Цукерберга до президента Обами. Хоча багато з цих випадків використання є нешкідливими, інші додатки, такі як deepfake фішинг, є набагато мерзеннішими.

Хвиля зловмисників використовує штучний інтелект для створення синтетичного аудіо, зображень і відеовмісту, призначеного для видавання довірених осіб, таких як генеральні директори та інші керівники, щоб обманом змусити співробітників передати інформацію.

Однак більшість компаній просто не готові протистояти цим типам загроз. У 2021 році аналітик Gartner Дарін Стюарт написав допис у блозі, в якому попередив, що «підприємства намагаються захищатися від атак програм-вимагачів і не роблять нічого, щоб підготуватися до неминучої атаки на синтетичних медіа».

Зі стрімким розвитком штучного інтелекту та таких постачальників, як OpenAI, які демократизують доступ до штучного інтелекту та машинного навчання за допомогою нових інструментів, таких як ChatGPT, організації не можуть дозволити собі ігнорувати загрозу соціальної інженерії, яку створюють глибокі фейки. Якщо вони це зроблять, вони стануть уразливими до витоку даних.

ПодіяСаміт Smart Security за запитом

Дізнайтеся про важливу роль штучного інтелекту та машинного навчання в кібербезпеці та практичні приклади для окремих галузей. Дивіться сеанси за запитом сьогодні.

ПослухайтеХоча технологія deepfake все ще перебуває в зародковому стані, її популярність зростає. Кіберзлочинці вже починають експериментувати з ним, щоб атакувати нічого не підозрюючих користувачів і організації.

За даними Всесвітнього економічного форуму (WEF), кількість онлайн-відео з дипфейками зростає щорічно на 900%. Тим часом VMware виявила, що двоє з трьох захисників стверджують, що вони бачили використання шкідливих глибоких фейків як частину атаки, що на 13% більше, ніж минулого року.

Ці атаки можуть бути надзвичайно ефективними. Наприклад, у 2021 році кіберзлочинці використовували клонування голосу ШІ, щоб видати себе за генерального директора...

What's Your Reaction?